На днях непроизвольно любопытный эксперимент получился.

Я в основном сейчас использую 2 нейросети:

▪️Бесплатный Qwen для быстрых вопросов и поиска в интернете.

▪️Платный z.ai в режиме агента в opencode. Мне очень нравится, как он работает. Делал ещё один заход в openclaw, но опять не пошло. Не нравится он мне. На очереди claude agent, но не хватает времени на него, чтобы плотно заняться.

Всё остальное смотрю эпизодически в рамках исследования и изучения. Никак не подберу какую-то десктопную платформу, чтобы ежедневную мелкую рутину за меня делал. Для всех остальных задач мне очень нравится opencode. Он закрыл почти все мои потребности в автоматизации.

Я не так давно пересобрал один старый системник, который работал как обычный рабочий комп под виндой. Воткнул в него все старые диски, что лежали без дела и стал туда свои бэкапы лить. Кстати, посмотрел стоимость дисков сейчас 😱 Они пипец как подорожали. Всё моё б.у.шное барахло, что я туда воткнул, потянуло на 100 т.р.

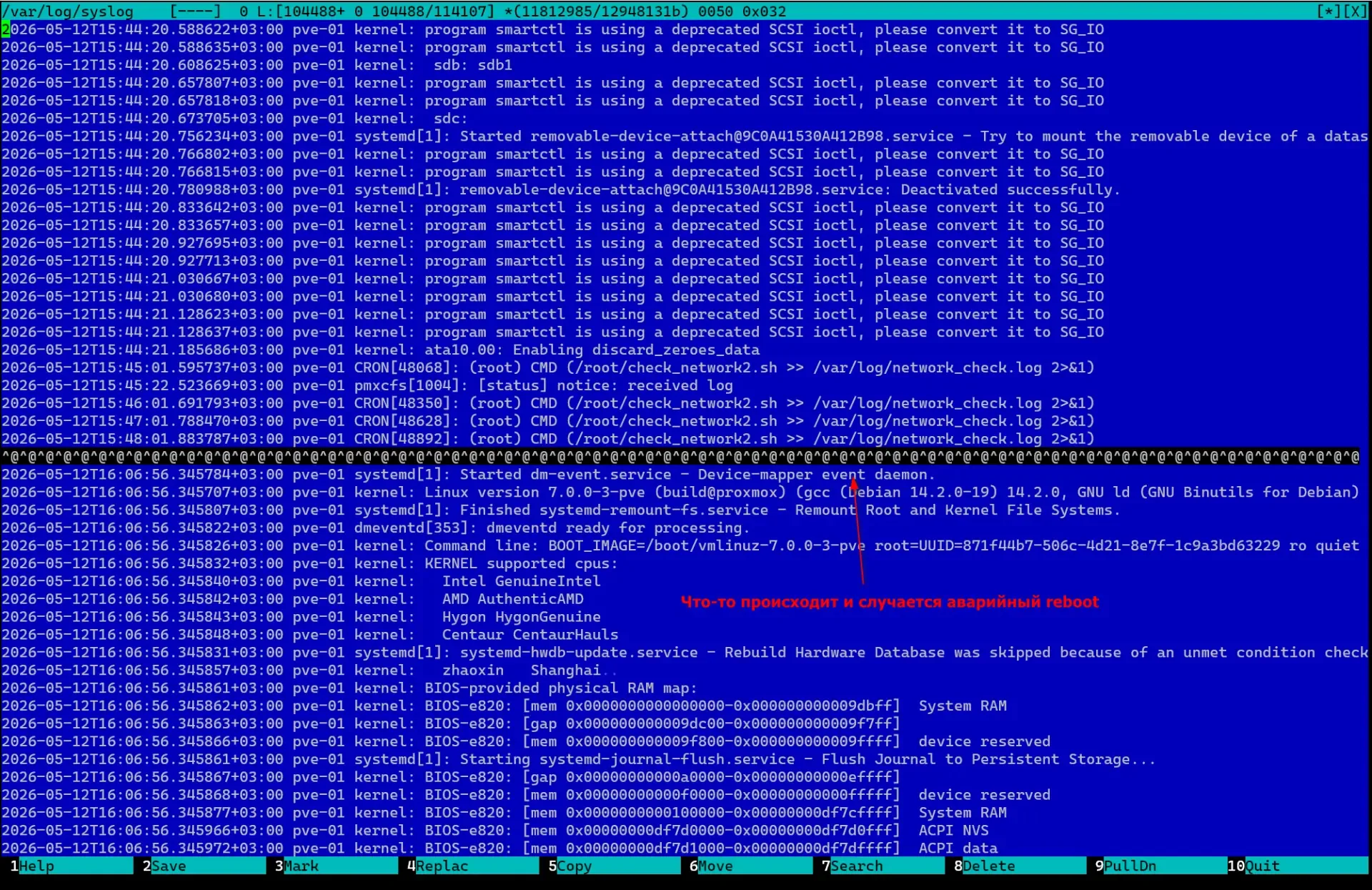

Системник был на 100% рабочий, проблем с ним не было. Я его продул, обновил термопасту, воткнул диски, накатил PVE. Какое-то время он поработал и начал аварийно перезагружаться без каких-либо видимых причин. Явных ошибок в логах нет, тем более перед ребутами. Ничего подозрительного не видно.

Решил скормить syslog нейронкам, чтобы они там покопались и вынесли свой вердикт. Заморачиваться не стал, отдал в opencode весь лог на 12 МБ и попросил проверить. Он нашёл там некоторые моменты, типа ошибок в SMART одного из дисков и ошибки сетевой карты Realtek. Это известная тема, они глючат в Linux, и в PVE в частности. Я уже писал об этом не раз. Сталкивался много раз с этим, но к аварийным перезагрузкам это никогда не приводило. Вряд ли в этом дело.

Это днём было, а вечером я вайбкодил и решал некоторые задачи. Зашёл в статистику по токенам и заметил, что днём куда-то 1,1 млн. токенов улетели. Это не сказать, что много, но лично у меня незаметно столько не улетает. Задачи относительно простые и короткие. Потом уже сообразил, что это анализ лога столько сожрал.

В то же время я этот же лог дал для теста другой закрытой нейронке с линуксовым агентом, которого я сейчас тестирую. Я не знаю, на базе чего работает сетка, у меня доступ только к агенту. И он поступил более разумно. Не стал анализировать весь лог, а грепнул его по ключевым словам. И это по ресурсам было раз в 100 экономичнее, так как с ошибками было несколько десятков строк против 110 тыс. всего лога.

В итоге агенты дали два разных решения. Первый сказал, что виноват диск, надо его отключить. Второй предложил установить другой драйвер на сетевуху, обвинив его в ребутах. Ни то, ни другое не помогло. Причина не в этом. Скорее всего просто железо устало. Материнка старая (14 лет), пора в утиль. Хотя под виндой работала стабильно. Может просто совпадение и время пришло именно сейчас, а может реально с современным линуксом у этого железа какой-то конфликт.

К чему я всё это рассказал. Для успешного решения задач к ИИ полагается приложить опытного специалиста, который умеет и понимает, как с нейронкой работать. Без этого либо результат будет неудовлетворительный, либо по ресурсам будет огромный перерасход. Нельзя просто так взять и отдать все логи на анализ. Надо выстроить рабочий процесс, который позволит эффективно анализировать и не тратить слишком много денег на это.

У меня много примеров было, когда надо было как-то оптимизировать работу агента, а не решать задачу в лоб. Привёл именно этот, потому что он самый простой и наглядный. Я не ожидал, что простой анализ небольшого лога сожрёт столько токенов. Причём это было сделано быстро. Я даже не обратил внимания. Если нет лимитов и подписки, то можно очень быстро прогореть на лютом перерасходе на какой-то неочевидной задаче.

#ai